Las Guerras de Destilación: ¿Espionaje o Eficiencia?

Resumen

Resumen

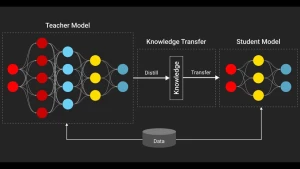

La startup de IA Anthropic afirmó que tres laboratorios chinos de IA —DeepSeek, Moonshot AI y MiniMax— lanzaron "ataques de destilación a escala industrial" contra su chatbot Claude, utilizando aproximadamente 24,000 cuentas falsas y más de 16 millones de consultas a la API para robar sus capacidades de razonamiento y codificación. Anthropic enmarcó esto como una amenaza a la seguridad nacional, advirtiendo que los modelos destilados carecen de salvaguardias necesarias contra el mal uso en armas biológicas o ciberataques, e instó a controles de exportación más estrictos en EE. UU. La destilación de modelos es una técnica estándar y legítima donde un modelo "estudiante" más pequeño aprende de las salidas de un modelo "maestro" más grande; Anthropic y OpenAI la utilizan rutinariamente. Los críticos argumentan que el volumen de consultas citado (16 millones de intercambios) es comparable a las pruebas estándar a gran escala, y que MiniMax fue atrapado mientras entrenaba su próximo modelo. Además, la acusación enfrenta argumentos de hipocresía, ya que Anthropic ha enfrentado demandas y acuerdos con autores por supuestamente raspar material protegido por derechos de autor, como libros y música, para entrenar sus propios modelos de frontera, lo que lleva al argumento de "datos para mí, pero no para ti".

(Fuente:Aisuperhuman Substack)